أخلاقيات الذكاء الاصطناعي: كيف يمكن للتطوير المسؤول أن يُنقذ مستقبل البشرية

في عصرٍ يشهد تحولاً سريعًا للعالم من خلال الذكاء الاصطناعي، لم تكن أهمية التطوير الأخلاقي للذكاء الاصطناعي أكثر أهمية من أي وقت مضى. بينما نشق طريقنا عبر عام 2025، يقدم لنا التقاء التقدم التكنولوجي والمسؤولية الأخلاقية كلاً من الفرص والتحديات غير المسبوقة التي ستشكل مستقبل البشرية.

أساس التطوير المسؤول للذكاء الاصطناعي

يجب أن يستند تطوير الذكاء الاصطناعي إلى مبادئ أخلاقية قوية تعطي الأولوية للقيم الإنسانية والسلامة والفائدة المجتمعية. أكدت المبادرات العالمية الحديثة على الحاجة إلى إطار شامل يضمن تطوير أنظمة الذكاء الاصطناعي ونشرها بشكل مسؤول.

المبادئ الرئيسية لأخلاقيات الذكاء الاصطناعي

الشفافية والمساءلة

- التوثيق الواضح لأنظمة الذكاء الاصطناعي

- إمكانية تتبع عمليات صنع القرار

- إجراء عمليات تدقيق وتقييم منتظمة

العدالة وعدم التمييز

- القضاء على التحيز الخوارزمي

- تكافؤ فرص الوصول إلى فوائد الذكاء الاصطناعي

- التمثيل المتنوع في فرق التطوير

الخصوصية والأمان

- إجراءات قوية لحماية البيانات

- موافقة المستخدم والتحكم

- أفضل ممارسات الأمن السيبراني

التحديات والحلول الحالية

معالجة التحيز في أنظمة الذكاء الاصطناعي

سلطت الدراسات الحديثة الضوء على أنماط مقلقة من التحيز في أنظمة الذكاء الاصطناعي. وفقًا لتقرير هيئة الأمم المتحدة للمرأة الصادر في فبراير 2025، لا يزال التحيز الجنسي يشكل تحديًا كبيرًا في تطبيقات الذكاء الاصطناعي. يجب على المنظمات العمل بنشاط لتحديد هذه التحيزات والقضاء عليها من خلال:

- بيانات تدريب متنوعة

- اختبار التحيز بشكل منتظم

- فرق تطوير شاملة

- التشاور مع أصحاب المصلحة

أخلاقيات الذكاء الاصطناعي في المجال الطبي

حددت إرشادات المنتدى الاقتصادي العالمي لشهر يناير 2025 أربعة مبادئ أساسية للذكاء الاصطناعي المسؤول في الطب:

- مصلحة المريض هي الهدف الأساسي

- الشفافية في صنع القرار الطبي

- حماية خصوصية المريض

- الحفاظ على الإشراف البشري

الإطار التنظيمي العالمي

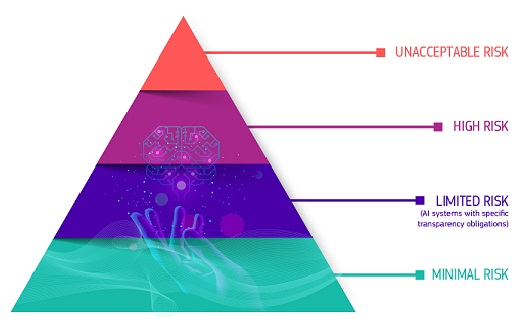

قانون الذكاء الاصطناعي الأوروبي

اضطلعت دول الاتحاد الأوروبي بدور رائد في وضع لوائح شاملة للذكاء الاصطناعي. اعتبارًا من فبراير 2025، يوفر قانون الذكاء الاصطناعي نهجًا منظمًا لما يلي:

- تصنيف مخاطر أنظمة الذكاء الاصطناعي

- المتطلبات الإلزامية للتطبيقات عالية المخاطر

- التزامات الشفافية

- مراقبة السوق

دور التعليم والتوعية

تلعب المبادرات التعليمية دورًا حاسمًا في ضمان تطوير مسؤول للذكاء الاصطناعي. تقوم منظمات مثل مبادرة MIT RAISE بدور رائد في برامج تعليم الذكاء الاصطناعي من مرحلة رياض الأطفال وحتى الصف الثاني عشر والتي تؤكد على:

- الاعتبارات الأخلاقية في تطوير الذكاء الاصطناعي

- المهارات الفنية المتوازنة مع القيم الإنسانية

- التفكير النقدي حول آثار الذكاء الاصطناعي

- التطبيق العملي لمبادئ الذكاء الاصطناعي المسؤولة

مسؤولية الشركات

تتزايد اعتماد شركات التكنولوجيا الكبرى لأطر أخلاقية شاملة. يؤكد تقرير Google لعامي 2024-2025 عن الذكاء الاصطناعي المسؤول على:

- مبادئ التصميم التي تتمحور حول المستخدم

- الاستدامة البيئية

- تقييم الأثر الاجتماعي

- المراقبة والتحسين المستمرين

اعتبارات مستقبلية

بينما نتطلع إلى المستقبل، تتطلب العديد من المجالات الرئيسية الاهتمام:

التأثير البيئي

- أنظمة ذكاء اصطناعي موفرة للطاقة

- ممارسات الحوسبة المستدامة

- تقليل البصمة الكربونية

التأثير الاجتماعي

- تكيف سوق العمل

- تنمية المهارات

- المساواة الاقتصادية

الحوكمة

- التعاون الدولي

- وضع المعايير

- آليات الإنفاذ

خطوات عملية للتنفيذ

للمنظمات

- إنشاء لجان للأخلاقيات

- تنفيذ عمليات تدقيق منتظمة

- توفير التدريب للموظفين

- التفاعل مع أصحاب المصلحة

للمطورين

- اتباع المبادئ التوجيهية الأخلاقية

- توثيق عملية صنع القرار

- النظر في التأثير المجتمعي

- الحفاظ على الشفافية

للمستخدمين

- البقاء على اطلاع

- المطالبة بالمساءلة

- المشاركة في المناقشات

- الإبلاغ عن المخاوف

اتخاذ الإجراءات اليوم

يتطلب الطريق إلى تطوير مسؤول للذكاء الاصطناعي جهدًا والتزامًا جماعيين. من خلال تنفيذ أطر أخلاقية والحفاظ على الشفافية وإعطاء الأولوية للقيم الإنسانية، يمكننا ضمان استفادة البشرية جمعاء من التطورات في مجال الذكاء الاصطناعي.

هل أنت مستعد للتعمق أكثر في أخلاقيات الذكاء الاصطناعي والتطوير المسؤول؟ استكشف دوراتنا ومواردنا الشاملة في 01TEK. انضم إلى مجتمع من المهنيين التقدميين الملتزمين بصياغة مستقبل أخلاقي للذكاء الاصطناعي. تفضل بزيارة موقعنا على الإنترنت لمعرفة المزيد عن برامجنا المتخصصة في أخلاقيات الذكاء الاصطناعي والتطوير المسؤول.

المصادر:

My number one piece of advice is: you should learn how to program.

Mark Zuckerberg, founder of Facebook