سلاح ذو حدين: عندما تتحول التنبؤات البيومترية إلى ثغرات أمنية

في المشهد التكنولوجي سريع التطور اليوم، أصبح الذكاء الاصطناعي متكاملاً بعمق في أنظمة الأمان لدينا، لا سيما في مجال المصادقة البيومترية. في حين أن هذه التطورات توفر راحة غير مسبوقة وتدابير أمنية، فإنها تقدم أيضاً نقاط ضعف كبيرة تستحق اهتمامنا الدقيق.

صعود أنظمة القياسات الحيوية المدعومة بالذكاء الاصطناعي

أحدث تكامل الذكاء الاصطناعي في أمن القياسات الحيوية ثورة في كيفية التحقق من الهويات وحماية المعلومات الحساسة. من التعرف على الوجه إلى مسح بصمات الأصابع، أصبحت هذه الأنظمة متطورة بشكل متزايد، مما يوفر تجارب مصادقة سلسة عبر مختلف المنصات. وفقاً للتطورات الأخيرة، شهد سوق حلول القياسات الحيوية المدعومة بالذكاء الاصطناعي نمواً هائلاً، مع تطبيقات تمتد من أمن الهواتف الذكية إلى أنظمة مراقبة الحدود الوطنية.

فهم نقاط الضعف

ومع ذلك، يأتي هذا التقدم التكنولوجي مع مخاطر متأصلة. حددت الأبحاث الحديثة العديد من نقاط الضعف الحرجة في أنظمة القياسات الحيوية القائمة على الذكاء الاصطناعي:

هجمات التزييف العميق: يمكن لخوارزميات الذكاء الاصطناعي المتقدمة الآن إنشاء بيانات بيومترية تركيبية مقنعة للغاية، مما قد يخدع أنظمة الأمان.

مخاوف خصوصية البيانات: يخلق تخزين ومعالجة المعلومات البيومترية أهدافاً محتملة لمجرمي الإنترنت.

تحيز الخوارزمية: قد تظهر أنظمة الذكاء الاصطناعي تحيزات متأصلة بناءً على بيانات التدريب الخاصة بها، مما يؤدي إلى التمييز والإيجابيات/السلبيات الخاطئة.

الاستجابة التنظيمية والامتثال

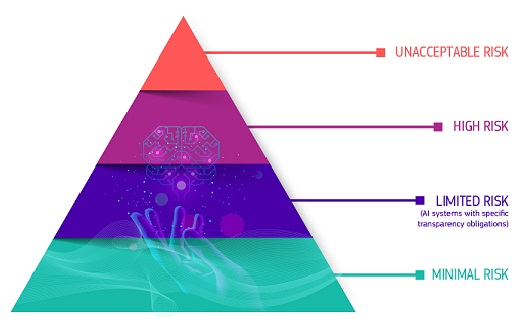

اتخذ الاتحاد الأوروبي خطوات كبيرة لمعالجة هذه التحديات من خلال قانون الذكاء الاصطناعي، وهو أول تنظيم شامل للذكاء الاصطناعي في العالم. يتناول التشريع على وجه التحديد:

- أنظمة التعرف البيومتري في الوقت الفعلي

- متطلبات حماية البيانات

- شفافية الخوارزمية

- تقييمات الأمان الإلزامية

يجب على المؤسسات الآن ضمان امتثال أنظمة القياسات الحيوية التي تعمل بالذكاء الاصطناعي لهذه اللوائح مع الحفاظ على تدابير أمنية فعالة.

التهديدات الناشئة والتدابير المضادة

مشهد التهديد الحالي

يفيد المنتدى الاقتصادي العالمي أن الجرائم الإلكترونية المدفوعة بالذكاء الاصطناعي قد ارتفعت بشكل كبير في عام 2025، حيث أصبحت الهجمات المتطورة التي تستهدف أنظمة القياسات الحيوية شائعة بشكل متزايد. يستخدم مجرمو الإنترنت أدوات الذكاء الاصطناعي المتقدمة من أجل:

- إنشاء بيانات بيومترية تركيبية

- استغلال نقاط ضعف النظام

- تنفيذ عمليات سرقة هوية واسعة النطاق

حلول الأمن

لمكافحة هذه التهديدات الناشئة، تقوم المؤسسات بتنفيذ مناهج أمنية متعددة الطبقات:

- كشف الحيوية: خوارزميات متقدمة يمكنها التمييز بين البيانات البيومترية الحقيقية والتركيبية

- المصادقة متعددة العوامل: الجمع بين القياسات الحيوية وطرق المصادقة الأخرى

- التخزين المشفر: التشفير الآمن للقوالب البيومترية

- عمليات تدقيق أمنية منتظمة: المراقبة والتقييم المستمر لنقاط ضعف النظام

أفضل الممارسات للمؤسسات

للحفاظ على أمان قوي مع الاستفادة من أنظمة القياسات الحيوية التي تعمل بالذكاء الاصطناعي، يجب على المؤسسات:

- تنفيذ التحديثات المنتظمة: حافظ على تحديث جميع أنظمة الأمان والخوارزميات بأحدث التصحيحات والتحسينات

- إجراء اختبار شامل: اختبر الأنظمة بانتظام بحثاً عن نقاط الضعف والاستغلال المحتمل

- تدريب الموظفين: تأكد من أن جميع الموظفين يفهمون بروتوكولات الأمان وأفضل الممارسات

- الحفاظ على الامتثال: ابق على اطلاع بمتطلبات اللوائح ومعايير الصناعة

- الاستثمار في البحث: استكشاف تدابير وتقنيات أمنية جديدة باستمرار

التداعيات المستقبلية

من المحتمل أن يشهد مستقبل أمن القياسات الحيوية المدعوم بالذكاء الاصطناعي:

- تكامل محسن للحوسبة الكمية لتحسين التشفير

- تطوير تدابير أكثر تطوراً لمكافحة الانتحال

- تركيز أكبر على طرق المصادقة التي تحافظ على الخصوصية

- زيادة التركيز على تطوير الذكاء الاصطناعي الأخلاقي

الخلاصة

في حين أن أنظمة القياسات الحيوية التي تعمل بالذكاء الاصطناعي توفر حلولاً أمنية قوية، يجب على المؤسسات أن تظل يقظة بشأن نقاط الضعف المحتملة. يتطلب النجاح في هذا المجال اتباع نهج متوازن يجمع بين الابتكار التكنولوجي وتدابير الأمن القوية والامتثال التنظيمي.

هل أنت مستعد لتعزيز معرفتك بالأمن السيبراني؟ استكشف دوراتنا ومواردنا الشاملة في 01TEK لتبقى في صدارة عالم الذكاء الاصطناعي وأمن القياسات الحيوية سريع التطور. قم بزيارة www.01tek.com لمعرفة المزيد عن برامج التدريب المتخصصة ودورات الشهادات لدينا.

المصادر: [1] معهد القياسات الحيوية - منتدى الاستراتيجية الأمريكية 2025 [2] المنتدى الاقتصادي العالمي - تقرير الجرائم الإلكترونية المدفوعة بالذكاء الاصطناعي [3] إطار عمل قانون الذكاء الاصطناعي للاتحاد الأوروبي [4] تقرير ENISA للأمن السيبراني 2025 [5] إرشادات معلومات القياسات الحيوية للجنة التجارة الفيدرالية

A poorly implemented feature hurts more than not having it at all.

Noah Everett, founder of Twitpic